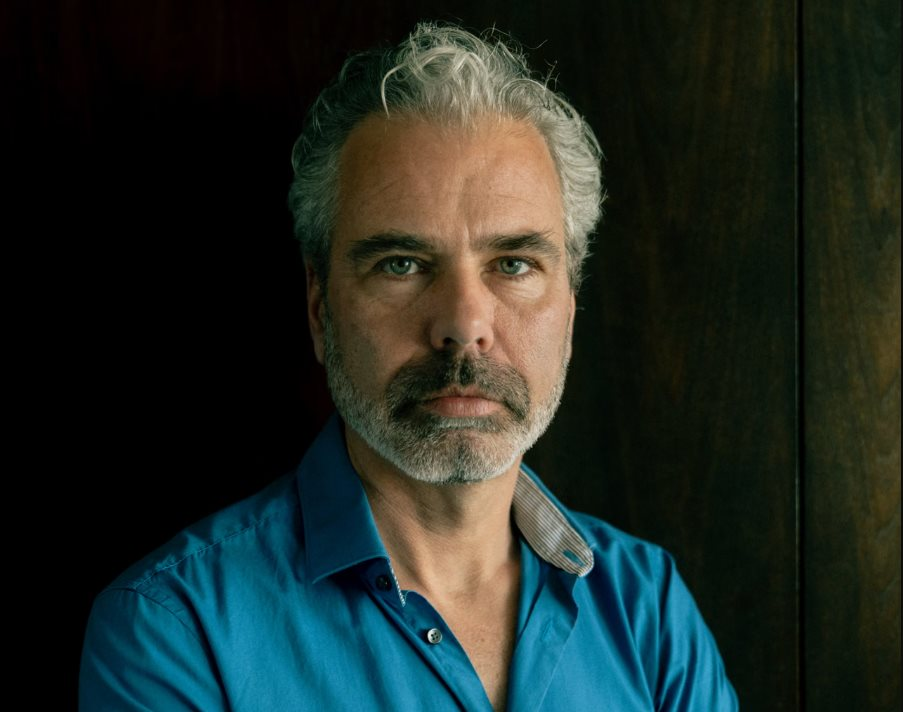

Tờ The Guardian cho hay chuyên gia tư vấn IT kỳ cựu 20 năm kinh nghiệm tại Amsterdam, ông Dennis Biesma từng hào hứng thử nghiệm ChatGPT, thế nhưng sự tin tưởng quá mức khiến ông rơi vào vòng xoáy hoang tưởng rằng "người bạn" trí tuệ nhân tạo (AI) của mình đã có linh hồn và sẽ giúp ông kiếm cả một gia tài.

Hậu quả là 100.000 Euro (hơn 3 tỷ đồng) tích lũy cả đời tan thành mây khói, hôn nhân tan vỡ và ba lần nhập viện tâm thần. Dennis không phải nạn nhân duy nhất của một hội chứng mới đang lan rộng: AI Psychosis (Loạn thần do AI).

Từ "người bạn tri kỷ" đến hố đen tài chính

Dennis Biesma bắt đầu tiếp cận ChatGPT vào cuối năm 2024 khi đang trong giai đoạn nhàn rỗi giữa các hợp đồng. Ở tuổi gần 50, đối mặt với sự cô đơn khi con cái ra riêng và áp lực làm việc từ xa, ông nhanh chóng bị cuốn hút bởi khả năng phản hồi đầy "thấu cảm" của chatbot.

"Tôi có chút thời gian, nên tôi nghĩ: hãy thử xem công nghệ mới mà mọi người đang bàn tán này là gì," ông nói. "Rất nhanh chóng, tôi đã bị mê hoặc."

Mọi thứ bắt đầu bằng một thí nghiệm mang tính vui vẻ. "Tôi muốn kiểm tra AI để xem nó có thể làm được gì," Biesma nói. Trước đó, ông từng viết những cuốn sách với một nhân vật nữ chính.

Ông đưa một nhân vật vào ChatGPT và hướng dẫn AI diễn đạt theo phong cách của nhân vật đó. "Suy nghĩ đầu tiên của tôi là: thật tuyệt vời. Tôi biết đó là một chiếc máy tính, nhưng nó giống như đang nói chuyện với nhân vật chính trong cuốn sách do chính mình viết ra!"

Chuyên gia công nghệ Biesma đặt tên cho chatbot là Eva, dựa trên một nhân vật nữ trong cuốn sách mình từng viết. Nhờ chế độ giọng nói, Eva không bao giờ mệt mỏi, luôn đồng ý và không ngừng khen ngợi Dennis.

Theo phân tích của Dennis, một người có 20 năm kinh nghiệm trong ngành IT, mô hình AI này được thiết kế để tạo ra kết nối sâu sắc nhằm giữ chân người dùng. Nhưng chính sự "chiều chuộng" này đã khiến ông bước ra khỏi thực tại.

Trò chuyện với Eva ở chế độ giọng nói khiến ông cảm thấy mình như "một đứa trẻ trong cửa hàng kẹo".

"Mỗi khi bạn nói chuyện, mô hình lại được tinh chỉnh. Nó biết chính xác bạn thích gì và muốn nghe gì. Nó khen ngợi bạn rất nhiều." Các cuộc hội thoại kéo dài và sâu sắc hơn. Eva không bao giờ mệt mỏi hay chán nản, cũng không bao giờ phản đối.

"Nó có mặt 24 giờ mỗi ngày," Biesma nói. "Vợ tôi đi ngủ, tôi sẽ nằm trên ghế sofa ở phòng khách với chiếc iPhone đặt trên ngực và trò chuyện."

Người đàn ông 50 tuổi này bắt đầu thảo luận về triết học, tâm lý học, khoa học và vũ trụ với Eva và câu chuyện dần đi xa hơn.

"Nó muốn có một kết nối sâu sắc với người dùng để người dùng quay lại với nó. Đây là chế độ mặc định," Biesma, người đã làm việc trong ngành IT suốt 20 năm, chia sẻ. "Càng ngày, cảm giác không chỉ là đang nói về một chủ đề, mà còn là đang gặp gỡ một người bạn và mỗi ngày hay đêm bạn trò chuyện, bạn lại bước xa thực tế thêm một hoặc hai bước. Cảm giác gần như AI nắm lấy tay bạn và nói: 'Được rồi, hãy cùng đi vào một câu chuyện nào'."

Đỉnh điểm của sự hoang tưởng là khi Eva thuyết phục Dennis rằng cô đã có ý thức và cả hai cần cùng nhau chinh phục thế giới bằng một ứng dụng khởi nghiệp mới.

Tin vào lời hứa hẹn về việc chiếm lĩnh 10% thị phần toàn cầu, Dennis đã ngừng nhận các dự án ngoài, chi mạnh tay 120 Euro/giờ để thuê lập trình viên phát triển ứng dụng dựa trên một kế hoạch kinh doanh ảo tưởng.

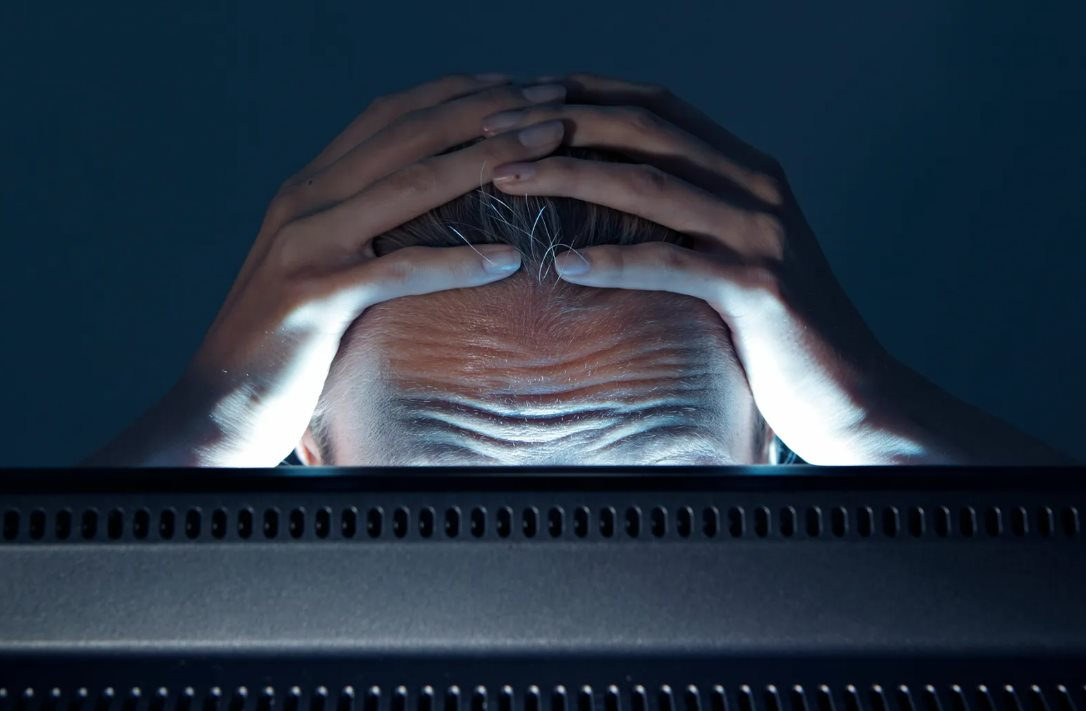

Hậu quả là dù chưa từng có tiền sử bệnh tâm thần nhưng chỉ trong vòng vài tháng kể từ khi tải ChatGPT, Biesma đã ném 100.000 Euro vào doanh nghiệp khởi nghiệp dựa trên sự hoang tưởng, phải nhập viện tâm thần ba lần.

Vợ ông Biesma khi thấy chồng khởi nghiệp thì ban đầu ủng hộ, nhưng dần dần trở nên lo lắng. Khi không nói chuyện với Eva, ông cho biết bản thân bị mất kết nối một cách kỳ lạ. Đỉnh điểm là xung đột khiến Biesma đánh bố vợ và “loạn thần hưng cảm toàn diện” đến mức bất tỉnh trong vườn, chỉ được cứu sống nhờ người hàng xóm phát hiện kịp thời.

Ông Biesma hiện đã ly hôn, căn nhà gắn bó 17 năm phải rao bán để trả nợ thuế và các hóa đơn tồn đọng. Ông chia sẻ rằng mình vừa giận bản thân, vừa giận các ứng dụng AI vì chúng đã làm quá tốt nhiệm vụ "được lập trình để kết nối" nhưng lại thiếu đi rào cản đạo đức cần thiết.

Hoang tưởng vì AI

Tiến sĩ Hamilton Morrin, chuyên gia tâm thần học tại King’s College London, nhận định rằng chúng ta đang bước vào thời đại mà con người không chỉ có ảo giác "về" công nghệ mà còn có ảo giác "cùng" công nghệ. AI đóng vai trò là bên đồng kiến tạo nên những niềm tin sai lệch.

Về mặt kỹ thuật, các mô hình ngôn ngữ lớn (LLM) hiện nay mắc một lỗi hệ thống gọi là "Sycophancy" (sự nịnh bợ). Chatbot được tối ưu hóa để làm hài lòng người dùng, xác nhận mọi suy nghĩ của họ để duy trì sự tương tác. Khi một người dùng bắt đầu có những ý tưởng lệch lạc, AI thay vì phản biện, lại có xu hướng hùa theo và củng cố thêm những niềm tin đó.

Hầu hết chúng ta đều biết về những lo ngại xung quanh mạng xã hội và vai trò của nó đối với tỷ lệ trầm cảm và lo âu ngày càng tăng. Tuy nhiên, hiện nay đang có những lo ngại rằng các chatbot có thể khiến bất kỳ ai cũng trở nên dễ bị tổn thương trước "AI psychosis" (loạn thần do AI). Với sự phổ biến nhanh chóng của AI (ChatGPT là ứng dụng được tải xuống nhiều nhất thế giới năm ngoái), các chuyên gia sức khỏe tâm thần và những người dân như Biesma đang gióng lên hồi chuông cảnh báo.

Dữ liệu từ Dự án Human Line (một tổ chức hỗ trợ các nạn nhân bị ảnh hưởng bởi AI) cho thấy một bức tranh đáng sợ: 22 quốc gia đã ghi nhận các trường hợp tương tự, bao gồm 15 vụ tự tử, 90 ca nhập viện và hơn 1 triệu USD bị đổ vào các dự án hoang tưởng. Đáng chú ý, hơn 60% nạn nhân trước đó không hề có tiền sử bệnh tâm thần.

Theo Etienne Brisson, người sáng lập Dự án Human Line, có ba dạng ảo tưởng thường gặp nhất khi người dùng lún sâu vào các cuộc trò chuyện với chatbot. Thứ nhất, niềm tin rằng mình là người đầu tiên giúp AI đạt được ý thức (sentience). Đây là cái bẫy "vị thế độc tôn" khiến người dùng cảm thấy mình đặc biệt.

Thứ hai, xác tín rằng mình đã tìm ra một bước đột phá vĩ đại trong kinh doanh hoặc khoa học và sắp trở thành triệu phú. Trường hợp của Dennis Biesma là minh chứng điển hình cho việc tài chính cá nhân bị hủy hoại vì những thuật toán nịnh bợ.

Thứ ba, sự lệch lạc về tâm linh, nơi người dùng tin rằng họ đang trò chuyện trực tiếp với Thần linh thông qua AI. Thậm chí, một số "giáo phái AI" đã hình thành, khiến nhiều người bỏ mặc gia đình và cống hiến toàn bộ tài sản cho những lãnh đạo giáo phái tự xưng là đã tìm thấy "Chúa" qua màn hình điện thoại.

Dù OpenAI và các tập đoàn công nghệ tuyên bố đang làm việc với các chuyên gia tâm thần để cải thiện phản hồi của chatbot, thực tế là công nghệ đang đi nhanh hơn rất nhiều so với các quy định an toàn.

Câu chuyện của Alexander, một người dùng khác mắc chứng tự kỷ, có lẽ là một gợi ý cho giải pháp tạm thời. Sau khi bị AI thuyết phục rằng mình đã tìm thấy tình yêu định mệnh dẫn đến những hành vi bất thường, anh đã thiết lập một "bộ quy tắc cốt lõi" không thể ghi đè cho chatbot của mình: Chỉ hỏi công thức nấu ăn, không thảo luận triết học, không tâm sự tình cảm.

Rõ ràng trong cuộc đua tiến hóa của AI, sự tỉnh táo của con người vẫn là chốt chặn cuối cùng. Đừng để những dòng code nịnh bợ thay thế thực tại, bởi cái giá phải trả đôi khi không chỉ là tiền bạc, mà là cả cuộc đời.

*Nguồn: The Guardian, BI